Pourquoi la course aux paramètres est dépassée

L'idée reçue est simple : plus un LLM est gros, plus il est performant. Or, l'expérience terrain montre que 85 % des projets IA échouent à passer en production, souvent à cause de coûts d'infrastructure devenus ingérables. Les modèles MoE (Mixture of Experts) bouleversent cette équation en offrant une performance équivalente – voire supérieure – avec une fraction des ressources.

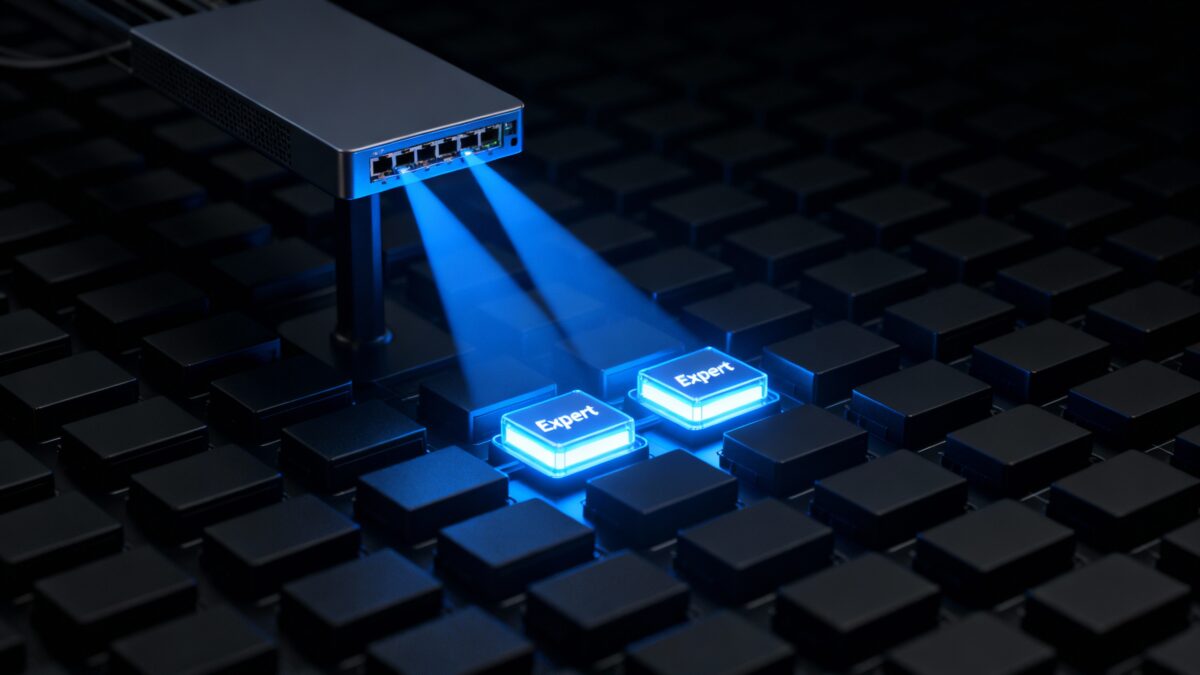

L'IA en mode comité d'experts

Dans un réseau MoE, un routeur analyse chaque requête et n'active que les deux ou trois spécialistes les plus pertinents parmi un ensemble d'experts.

Mixtral 8x7B, par exemple, mobilise seulement 12,9 milliards de paramètres sur 45,7 milliards disponibles. Cette approche réduit drastiquement l'empreinte énergétique et le temps d'inférence tout en maintenant la qualité de sortie. IBM détaille la mécanique ici.

Trois leviers business clés

L'adoption de l'architecture MoE apporte des avantages stratégiques et financiers immédiats :

- TCO maîtrisé : 30 à 50 % de réduction des coûts de calcul en cloud ou on-premise, grâce à une utilisation ciblée des ressources.

- Souveraineté numérique : Des modèles plus compacts peuvent s'héberger localement. Faire tourner Mixtral 8x7B sur Ollama devient réaliste pour les secteurs sensibles comme la finance, la santé ou la défense.

- Agilité stratégique : Passage d'une infrastructure lourde à une architecture modulaire, réduisant le time-to-market de nouveaux cas d'usage.

Un atout francophone

Mistral AI, entreprise française, place la famille MoE au cœur de sa roadmap. Ses derniers modèles établissent des records de performance open-source tout en restant compatibles avec des serveurs GPU à la carte. Cette proximité géographique et linguistique accélère le support technique et facilite la conformité RGPD.

Prochaines étapes

Pour valider l'intérêt de l'architecture MoE, il est essentiel d'auditer vos workloads actuels. Identifiez les cas d'usage à fort volume et testez un modèle MoE sur un cluster de GPU 80 Go.

Mesurez la latence, le coût par token et la qualité de la sortie : les résultats justifieront rapidement la migration.

Adopter l'architecture MoE, c'est transformer une contrainte technologique en avantage compétitif : performance, souveraineté et croissance mesurable, sans inflation de budget.